Gemma 3是什么?

Gemma 3 是谷歌研发的 AI 大模型,于 2025 年 3 月 12 日正式推出。它专为开发者设计,旨在支持他们构建能够在多种设备上运行的人工智能应用。

主要功能

多语言支持:能为超过 35 种语言提供开箱即用的支持,并对 140 多种语言提供预训练支持,可构建使用多种语言的应用 。

视觉推理:可构建分析图像、文本和短视频的应用程序。比如能处理图像和视频输入,分析图像、回答与图像相关问题、对比图像、识别物体以及读取和解析图像中的文本等。例如上传一张日语空调遥控器图,能根据图像中「暖房」文字,分析出在日语中其意为「加热」,进而判断出这是用于开启空调或气候控制系统加热功能的按钮。

处理复杂任务:提供 128k token 的上下文窗口,可处理和理解大量信息,处理约 30 张高分辨率图像、一本 300 页的书籍或一小时以上的视频 。

支持函数调用和结构化输出:能帮助用户自动化任务并构建代理式体验,结合大型上下文窗口,可摄入大量数据并自动化复杂的顺序任务。

技术原理

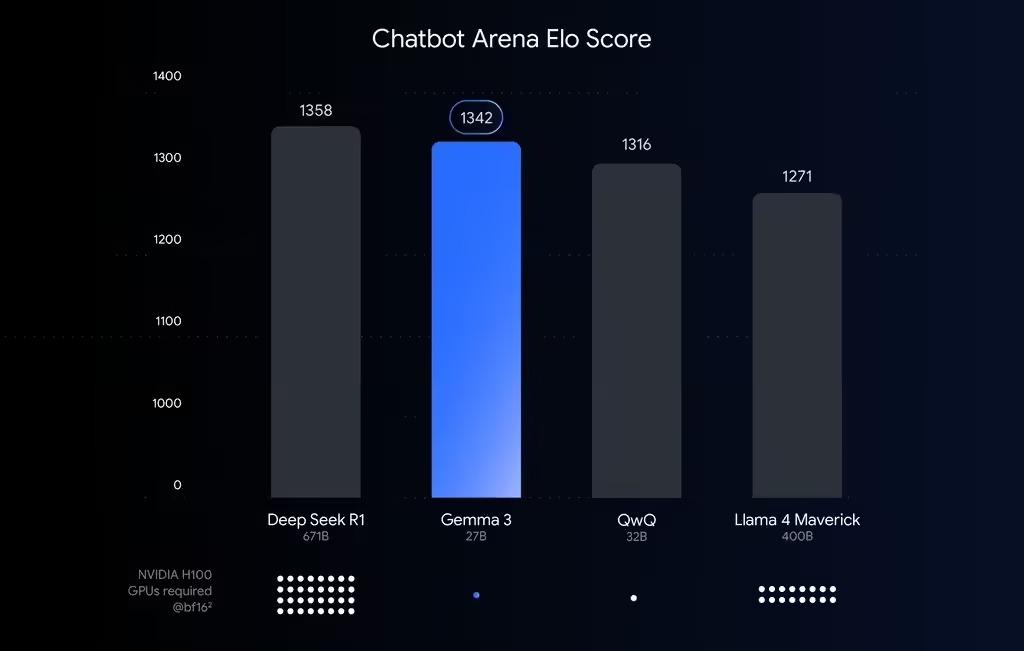

量化感知训练(QAT)技术:为解决量化导致的性能下降问题,谷歌采用 QAT 技术。在训练过程中模拟低精度运算,确保模型在压缩后仍保持高准确性。在约 5000 步训练中,Gemma 3 QAT 模型将困惑度下降减少了 54%。

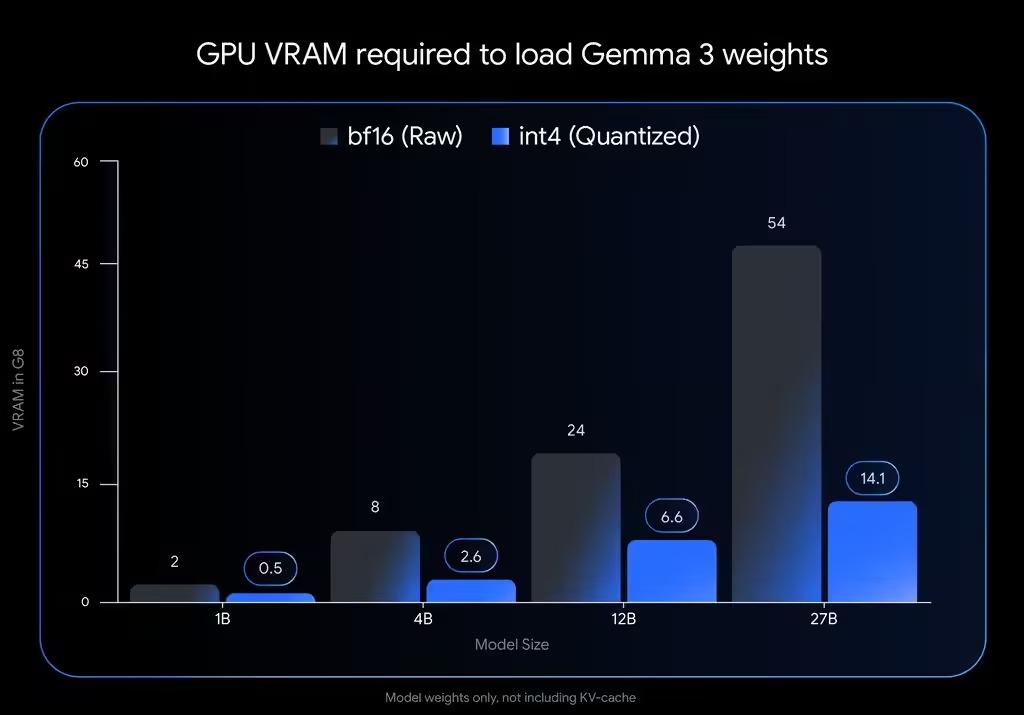

量化技术降低显存需求:通过降低模型参数的数值精度,如从 BF16 的 16 位降至 int4 的 4 位,类似图像压缩减少颜色数量的原理,大幅减少数据存储量。以 int4 量化为例,Gemma 3 27B 显存需求从 54GB 锐减至 14.1GB,Gemma 3 12B 则从 24GB 降至 6.6GB,Gemma 3 1B 仅需 0.5GB 显存。这样使得用户可在桌面(如 NVIDIA RTX 3090)、笔记本(如 NVIDIA RTX 4060 Laptop GPU)甚至手机上运行该模型。

应用场景

端侧设备应用开发:可在从手机、笔记本电脑到工作站等多种端侧设备上运行,帮助开发者创建 AI 应用。例如在手机上开发具有图像分析、文本处理功能的 APP,在工作站上开发更复杂的多模态应用程序等。

主流平台集成:Ollama、LM Studio 和 llama.cpp 等主流平台已集成该模型。用户可通过 Hugging Face 和 Kaggle 获取官方 int4 和 Q4_0 模型,轻松在 Apple Silicon 或 CPU 上运行;Gemmaverse 社区也提供了更多量化选项,满足不同需求。

发表评论